脑子是个好东西,芯片能模仿一下吗

付斌丨作者

李拓丨编辑

果壳硬科技丨策划

出版于1968年的《仿生人会梦见电子羊吗?》曾大胆设想机器人也将拥有人的特质,这些仿生人会思考、会睡觉还会做梦,开启人们对于冰冷造物和生命间的思考。[1]

现在,那种充满赛博朋克色彩的世界似乎不再遥远。芯片结构已高度模仿生物大脑,开始拥有五感,并且越来越具备人的特征,它就是神经形态芯片,一种比现有CPU或GPU能耗比强一千倍以上的芯片。[2]

迄今为止,神经形态计算仍然在研究阶段,但接连而来产业化动作,昭示着这一技术将成就第一批吃螃蟹的人。[3]

从生物大脑到芯片

神经形态计算(Neuromorphic Computing)也被称为神经拟态计算,指的是参考生物大脑神经元结构和思考处理模式而搭建的架构,它是一种跳出传统冯·诺依曼架构的先进计算形式,据这一架构设计出来的芯片就是神经形态芯片。

简单解释,就是把人脑做进了芯片里。虽然乍听这样一个词语,非常晦涩难懂,但实际上,同样是借鉴人脑的人工智能(AI)技术早已进入千家万户[4]。只不过,神经形态芯片是一种架构更接近人脑的器件。

类脑芯片中的一种

神经形态计算也是一种类脑芯片(Brain-inspired Computing,也被称为脑启发计算)。

目前,类脑芯片的精确定义及范围划分,学术界、产业界意见尚未统一。一般粗略分为神经形态芯片(基于脉冲神经网络SNN)和深度学习专用处理器(基于人工/深度神经网络ANN/DNN),前者是从结构层逼近生物大脑,侧重于参照人脑神经元模型及其组织结构来设计芯片结构,后者则非神经元组织结构,而是围绕成熟认知计算算法,设计芯片结构。[5]

简单解释二者原理,深度学习专用处理器是降维处理,把多维问题转换为一维信息流;神经形态芯片是升维处理,通过多维时空变换,以期更接近人脑思考方式,从而获得更好的能耗、算力和效率。[6]

冯诺依曼架构与神经形态架构的对比,图源丨Nature Computational Science[7]

深度学习专用处理器属于另一个子行业,早在2012年,中科院计算所研制了当时国际上首个支持深度神经网络处理器架构芯片寒武纪[8],目前玩家包括Mythic、Graphcore、Gyrfalcon Technology、Groq、HAILO、Greenwaves、谷歌、地平线、寒武纪等。

两大方向并非彼此独立或互斥,而是交叉融汇。对于深度学习已非常擅长的,如模拟人类视觉或自然语言交互任务,会继续使用深度学习网络去应对;对于其它不太适合用深度学习做的,如嗅觉、机器人操控、多模态甚至于跨模态间存储等,将会采用新架构的神经形态芯片。

研究界和产业界都在逐渐模糊二者界限,但实际上,很多论文、报告或文章中的类脑芯片,指的是神经形态芯片。本文将采用更为精准的一种描述——神经形态芯片。

类脑计算两大平台特性[9]

生物大脑的特点

生物大脑能够实现感知、运动、思维、智力等各种功能,但由于其复杂性,目前对大脑的认识与理解还非常有限,这对神经形态芯片从认知原理、硬件实现、智能算法到双脑融合等都带来了挑战。[10]

以目前研究来看,生物大脑中,神经元细胞会通过树突、突触等实现信号传递与调整等功能,同时,神经元间会以脉冲信号形式相互交流。实际上,单个神经元的结构和功能并不复杂,但通过突触互连的大规模神经网络,就能实现各种复杂的学习和认知功能。[11]

另外,生物大脑与主流的人造芯片结构极为不同:

神经元和突触的信息处理结构不仅拥有更高效率,还可实现大规模并行处理;[12]

传统计算系统的冯·诺依曼计算架构,计算和存储分离,但生物大脑则是存储和处理一体,不存在单独的存储器,另外,生物大脑里也没有动态随机存取存储器、没有哈希层级结构、没有共享存储器等;[13](可参考果壳硬科技历史文章《存算一体芯片,人工智能时代的潜力股》)

生物大脑记忆并非一成不变,而是既有频繁重复的长时记忆,也有快速遗忘的短时记忆,两者互相转换表现在突触上,就是长/短时程可塑性的转变;[14]

计算机基本均为全数字信号的处理方式,而生物大脑则是混合信号,脑内通信使用数字信号快速传输,神经元和突触的处理使用更为有效的模拟化学形式。[15]

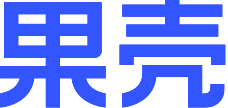

传统电路结构(左)对比人脑结构(右)[16]

但也不是说人造的器件就没有任何优点,假如能用CMOS构造出与生物大脑同等规模的器件,二者会呈现不同的优势领域,神经形态芯片最终一定是结合生物大脑和人造器件各自优点而设计制造。

生物大脑对比同等规模CMOS器件[16]

三种主流实现形式

早在1952年,就有研究将神经系统建模为等效电路[17],直到上世纪八十年代,超大规模集成电路(VLSI)发明者之一,加州理工大学的Carver Mead以此为灵感,创造了神经形态(Neuromorphic)这一术语,描述模仿生物神经系统某些功能的设备和系统。[18]

Carver Mead在内的科学家花了40多年时间潜心研究这项技术,最终目标是模拟人体感官和处理机制的分析系统,如触觉、视觉、听觉和思维。现在,神经形态芯片行业已发展出雏形。

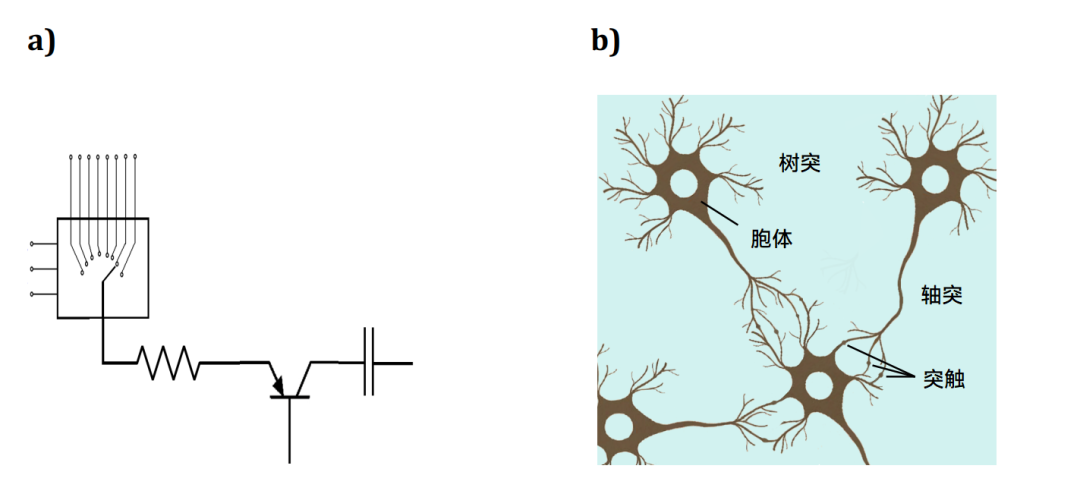

一颗理想的神经形态芯片背后是多个学科的碰撞,包括在材料上追求类生物物质,在器件上构造神经元与突触,在电路上实现神经网络连接,在算法上实现大脑思考能力[19]。不同神经形态芯片的涉及材料、器件、工艺极多,而它也将会自下而上地从材料、器件、电路、架构带动算法和应用。[7]

神经形态芯片涉及的领域和机会,图源丨Nature Computational Science,有改动[7]

目前为止,神经形态芯片的构造基本一致,包括神经元计算、突触权重存储、路由通信三部分,同时采用与脉冲神经网络(SNN)模型。[9]

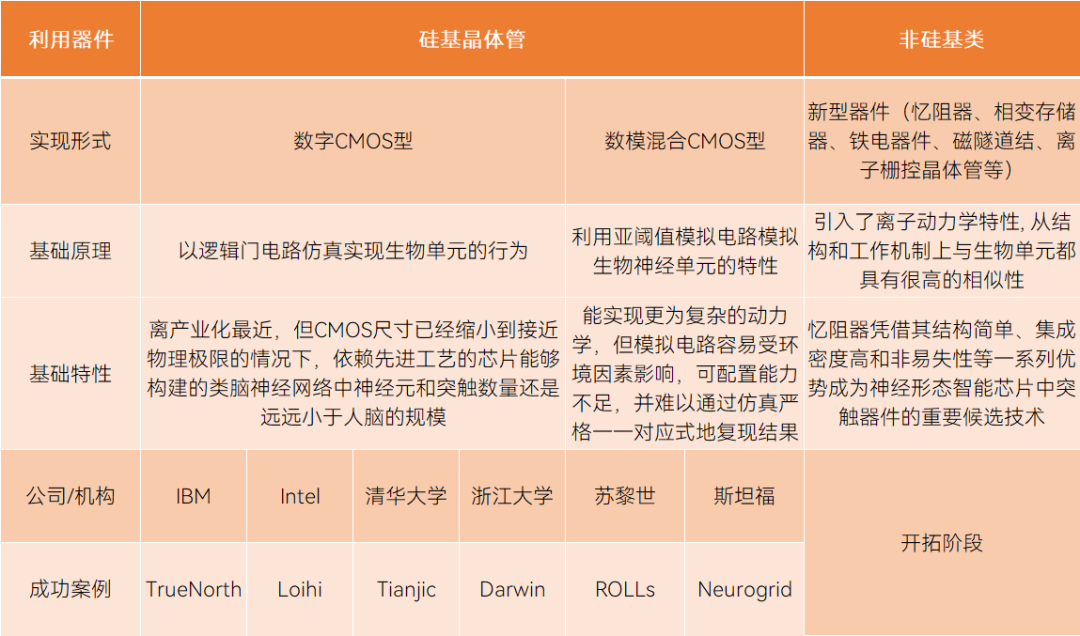

但依据材料、器件、电路不同,分为模拟电路主导的神经形态系统(数模混合CMOS型)、全数字电路神经系统(数字CMOS型)、基于新型器件的数模混合神经形态系统(忆阻器是候选技术)三种流派。

两种基于CMOS的方式能够继续利用现有制造技术,搭建人工神经元及其连接人工突触,但模拟单个神经元或突触行为,需要由多个CMOS器件组成电路模块,因此集成密度、功耗和功能模拟准确度会有所限制;新型器件从底层器件仿生的角度出发,在器件层面模拟神经元和突触,在功耗、学习性能等方面有显著优势,但目前仍处在探索阶段。[12]

其中,数字CMOS型是目前最易产业化的形式。一方面,技术和制造成熟度高,另一方面,不存在模拟电路的一些顾虑和限制。

神经形态芯片的三种实现形式,制表丨果壳硬科技

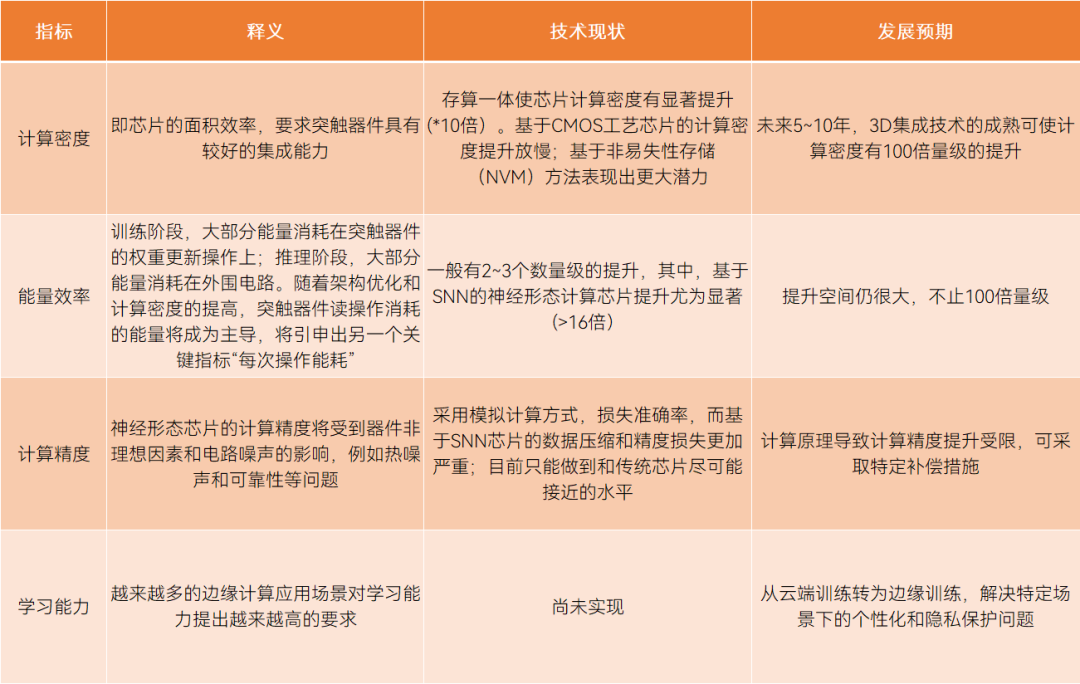

如何衡量一颗神经形态芯片的好坏?主要从计算密度、能量效率、计算精度和学习能力四项指标来评价其竞争力。[20]

神经形态芯片的四项关键指标和现状,制表丨果壳硬科技

资料来源丨Nature Electronics[20],《新经济导刊》[21]

解决行业燃眉之急

为什么要做神经形态芯片?它的商业价值在于能在低功耗以及少量训练数据的条件下持续不断自我学习,并且在理想情况下,同样一个人工智能任务中,神经形态芯片的能耗较传统的CPU或GPU减少了一千倍以上。

数字时代下,计算机的计算速度越来越快,甚至下起象棋来,还能战胜世界冠军。因此,人们亲切地把计算机称作电脑,但它的能效和智能程度还远达不到生物大脑。[22]

比如,AlphaZero是由5000个谷歌的专用机器学习处理器(TPU)组成的巨无霸,但每个单元功耗高达200W[23]。再如,IBM曾在深蓝超级计算机平台上仿真一只猫的脑皮层模型(相当于人类大脑的百分之一),就需近15万块CPU和144TB主存,能耗高达1.4MW。[24]

反观人类的大脑,由约850亿个神经元组成,通过一千万亿(1015)个神经突触连接在一起,每秒能够执行一亿亿次操作,但如此庞大的系统处理起日常任务的功耗只有20W[25]。与此同时,一个两岁的小孩,在任何角度、距离和光照条件下,都能毫无困难地从许多人中认出他/她所熟悉的人,智慧程度远超现有任何计算系统。[22]

所以,把芯片做成大脑,通过模仿生物大脑结构,神经形态芯片也确实拥有了能效比的特性。其独有的事件触发运算机制,当没有动态信息生成时,不会触发运算行为。同时,它还善于做复杂的时空序列分析,虽然单个神经元速率很低,但由于它和生物大脑的机制类似,可进行大规模并行运算,响应速度会远远快于现有解决方案。

可以说,神经形态芯片有潜力成为现在的救世主,解决行业面前的三大问题:一是数据量级大;二是数字形态日趋多元化,很多数据已不能依靠手动编辑输入或人工处理解决,需要智能化处理;三是应用对延时要求愈加强烈,传统单一计算架构会碰到性能和功耗的瓶颈。

另外,神经形态芯片还契合了绿色计算的概念。算力成为电力之后又一经济指标,耗能巨大的计算方式难挑大梁,能量优化的方式才是破解问题的最优解。据估算,数据中心每年会消耗约200太瓦时(TWh)的电力,这一数据已经相当于一些国家一年全国的耗电量。[26]

大规模商业化怎么走

虽然神经形态芯片处处都好,但它只在特定领域发挥特长,不会取代传统计算平台。CPU、GPU等传统数字计算芯片擅长精确计算,而神经形态芯片擅长非结构化数据、图像识别、嘈杂及不确定数据集分类、新型学习系统和推理系统等领域。

能颠覆特定领域计算的量子计算,其实也是同样的逻辑,它也不能脱离现有计算系统。未来的先进计算系统必然要求传统数字芯片、神经形态芯片和量子计算三者相互协同作战。[27]

目前来说,神经形态芯片难设计、难制造,尚未形成规模化市场。同时,业界一致认可的结论是,投资在神经形态芯片上面的钱,远远落后于人工智能或量子技术。[27]

小小一颗芯片,蕴含着半导体制造技术、脑科学、计算神经科学、认知科学、统计物理等学科知识[28],制造出这一颗芯片,要牵扯到物理学家、化学家、工程师、计算机科学家、生物学家和神经科学家这些关键角色,让如此众多角色去做同一件事、说同一门语言,毫无疑问是有挑战性的。

但其颠覆性的价值,引得全球加速商业化进程。数据显示,神经形态芯片市场将由2021年的2274.3万美元提升到2026年的5.5亿美元,年复合增长率高达89.1%。[29]另外,如果基本技术问题在未来几年内得到解决,那么到2035年,全球神经形态芯片市场将占整体人工智能市场的18%,达到220亿美元。[30]

那么,想推进大规模商业化,要解决什么问题?

其一,设计问题:大脑在实时处理复杂信息的同时,只消耗极少的能量,如何更好地理解这种高效工作机制,并把这些机制用到芯片中去,很难。仅拿商业化路径最近的数字CMOS型来说,多块全数字异步设计的芯片互联、芯片连接的有效性和时效性以及软件层互连计算、分布式计算和灵活分区都是难于跨过的鸿沟;

其二,制造问题:利用硅基晶体管路线可以复用现有制造技术,而非硅基路线还要解决底层制程、制造良率以及支撑大规模生产等问题,就算问题都解决了,做出了实验芯片,还要继续考虑产品化量级的稳定供应问题;

其三,软件和生态问题:神经形态芯片与现有架构完全不同,而社区中不少开发者是在底层构造自己的脉冲神经网络算法,并通过底层库把软件烧写进硬件做试验,这显然不是规模化的方案。大规模商业化,软件工具链就非常重要了;

其四,缺乏杀手级应用:不论是机器人、自动驾驶还是工业大规模优化,本身的逻辑应该是以应用驱动技术发展,在此基础上再持续不断建设生态系统。目前比较公认的观点是,神经形态技术最先将在消费电子、移动终端、工业物联网找到应用。

神经形态芯片的玩家

全球范围内,参与神经形态计算芯片开发的机构主要包括三类:英特尔、IBM、高通等为代表的科技巨头企业,斯坦福、清华为代表的高校/研究机构以及初创企业。[31]

神经形态计算玩家不完全统计,图源丨智东西[32]

国外发展情况

国外在神经形态芯片上的研究力度极大,不乏麻省理工学院、斯坦福大学、波士顿大学、曼彻斯特大学、海德堡大学等名校。科技巨头以英特尔、IBM、高通、三星为代表,初创企业包括BrainChip、aiCTX、Numenta、General Vision、Applied Brain Research、Brain Corporation等。[32]

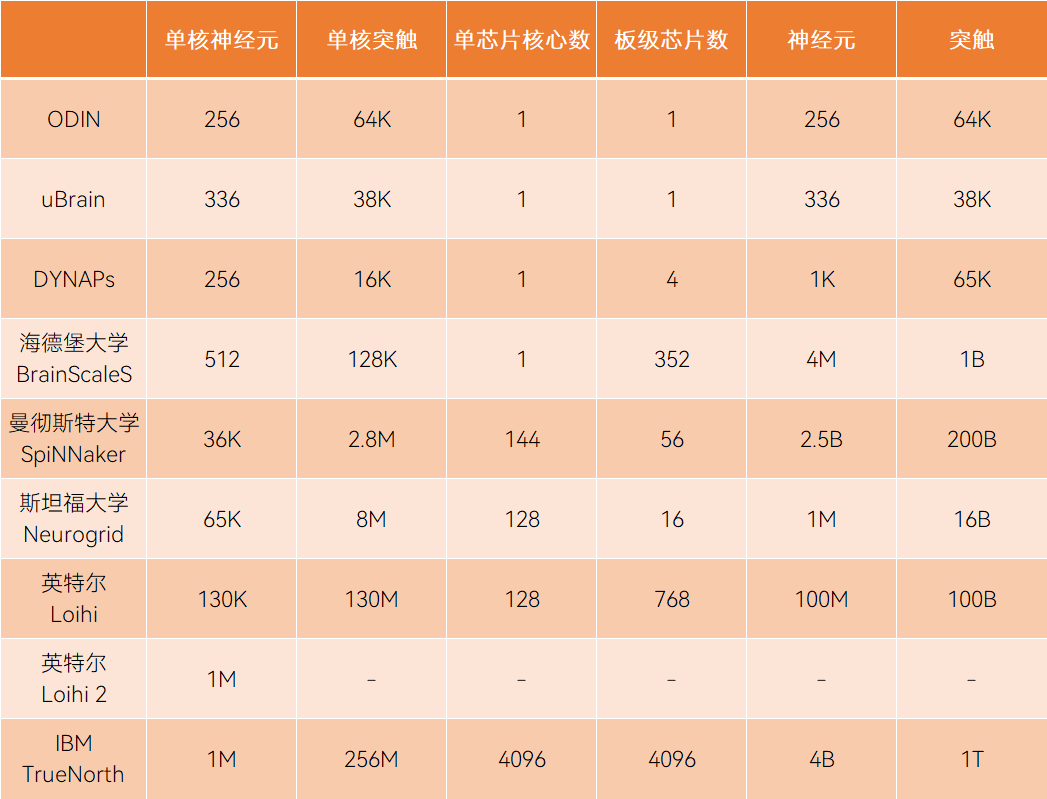

从研究和实施情况来看,英特尔和IBM的实验芯片最具代表性。

目前已知神经形态芯片详细参数对比,制表丨果壳硬科技

参考资料丨IEEE[33]

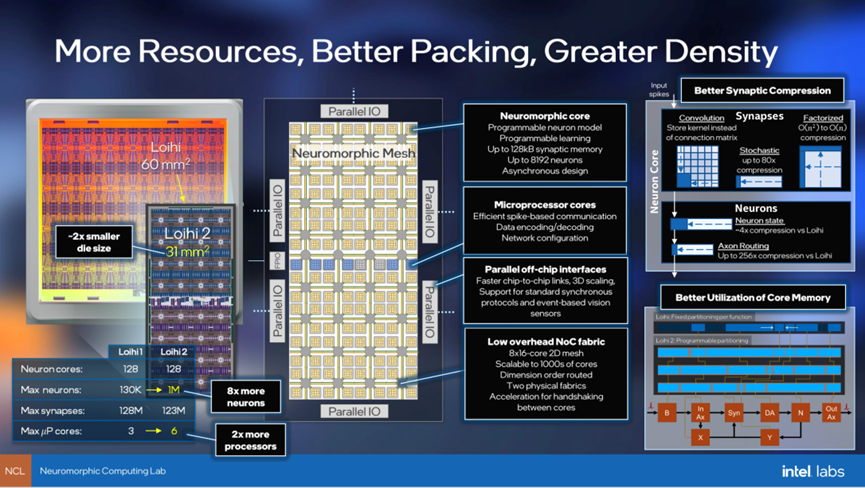

英特尔的Loihi是全数字设计的神经形态芯片。2017年,英特尔开发出第一款Loihi。2021年,英特尔在此基础上推出第二代Loihi2,采用Intel 4制程工艺生产,单芯片神经元数量达到100万。

英特尔神经形态芯片目前在感知领域应用已取得很大进展,包括手势识别、视觉推理以及多达三千倍学习数据的气味传感。另外,英特尔还开发出了一台将768颗Loihi芯片集成在5台标准服务器大小的机箱中的Pohoiki Springs数据中心机架式系统。

为了让神经形态芯片更好用,英特尔还推出了名为Lava的开源软件框架,它是一种无需使用专门硬件就可构建应用的软件,能在传统和神经拟态处理器的异构架构上无缝运行,并允许研究人员和应用开发人员在彼此取得的成果上进一步开发。[34]

英特尔并不急于将神经形态芯片商业化,与小公司维持特定应用不同,英特尔是把它当作一项通用技术,同时会以十亿美元以上的水平看待所有商业机会。

英特尔Loihi和Loihi2简介

TrueNorth则是IBM潜心研发将近10年的实验芯片,自从2008年起,美国DARPA计划就开始资助这项计划。2011年,IBM公司推出了第一代TrueNorth。

到2014年,IBM的第二代TrueNorth神经元数量由256个增加到100万个,可编程突触数量由262144个增加到2.56亿个,每秒可执行460亿次突触运算,总功耗为 70mW(每平方厘米功耗为20mW),整体体积仅为第一代类脑芯片的十五分之一。[5]

值得一提的是,IBM在2019年还曾推出名为Blue Raven的神经形态超级计算机,拥有6400万神经元和160亿个突触的处理能力,功耗仅为40W,相当于一个家用灯泡。[35]

国内发展情况

国内研究包括清华大学、浙江大学、复旦大学、中科院等顶级学府和机构,同时近两年不断涌现初创公司,如灵汐科技、时识科技、中科神经形态等。其中以清华大学的天机芯和浙江大学的达尔文芯片最具代表性。

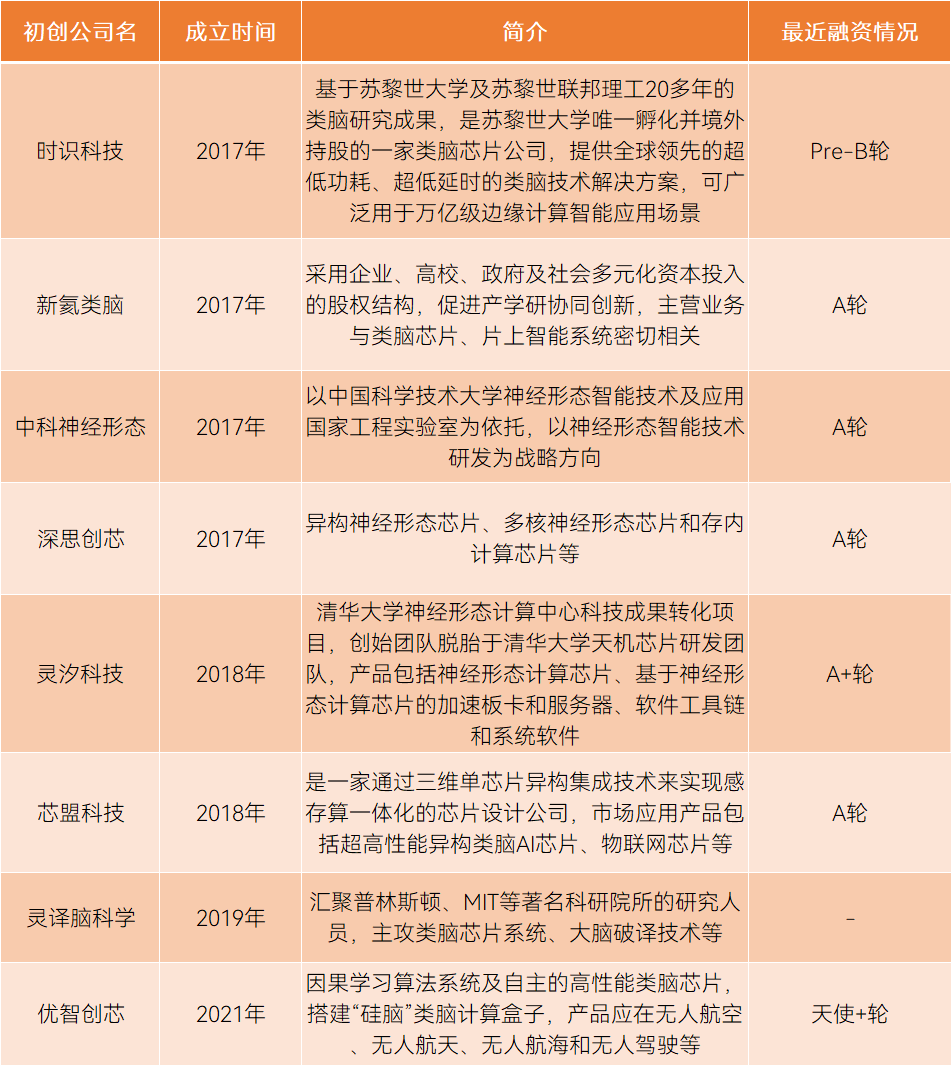

国内神经形态芯片初创企业不完全统计,制表丨果壳硬科技

资料来源丨公司官网,《新经济导刊》[21],量子位[36]

清华大学的神经形态芯片是国内最具代表性的实验芯片。2015年开发的第一代天机芯采用110nm工艺,当时仅仅是一个小样。2017年,第二代天机芯开始取得先进成果,基于28nm工艺制成,由156个功能核心FCore组成,包含约4万个神经元和1000万个突触。相比第一代,密度提升20%,速度提高至少10倍,带宽提高至少100倍。[37]

为了让神经形态芯片更具实用性,清华大学还自主研发了软件工具链,支持从深度学习框架到天机芯的自动映射和编译。根据清华大学的计划,下一代天机芯将是14nm或更先进的工艺,且功能会强大更多。[38]

国内另一具有代表性的是,浙江大学联合之江实验室共同研制的类脑计算机,其神经元数量与小鼠大脑神经元数量规模相当。该计算机包含792颗达尔文2代芯片,支持1.2亿个脉冲神经元、720亿个神经突触,如此庞大规模之下,典型运行功耗仅为350W~500W。[39]

事实上,国内在神经形态芯片领域的技术实力已处于全球领先水平,全球玩家都处在这一领域的起跑线上。

可以说,这是值得布局的一项技术。但它也是一块难啃的骨头,是材料、器件、工艺、架构、算法缺一不可的庞大赛道,是一个摸黑走到底的领域,同时未来必然会遇到应用场景和投入产出比问题。

不过,市场就是这样,谁敢挑战空白的领域,谁就能成为第一批拿到红利的人。

References: